xgboost 学习

xgboost 学习记录

xgboost 学习

主要学习方法B站UP-老弓的学习日记

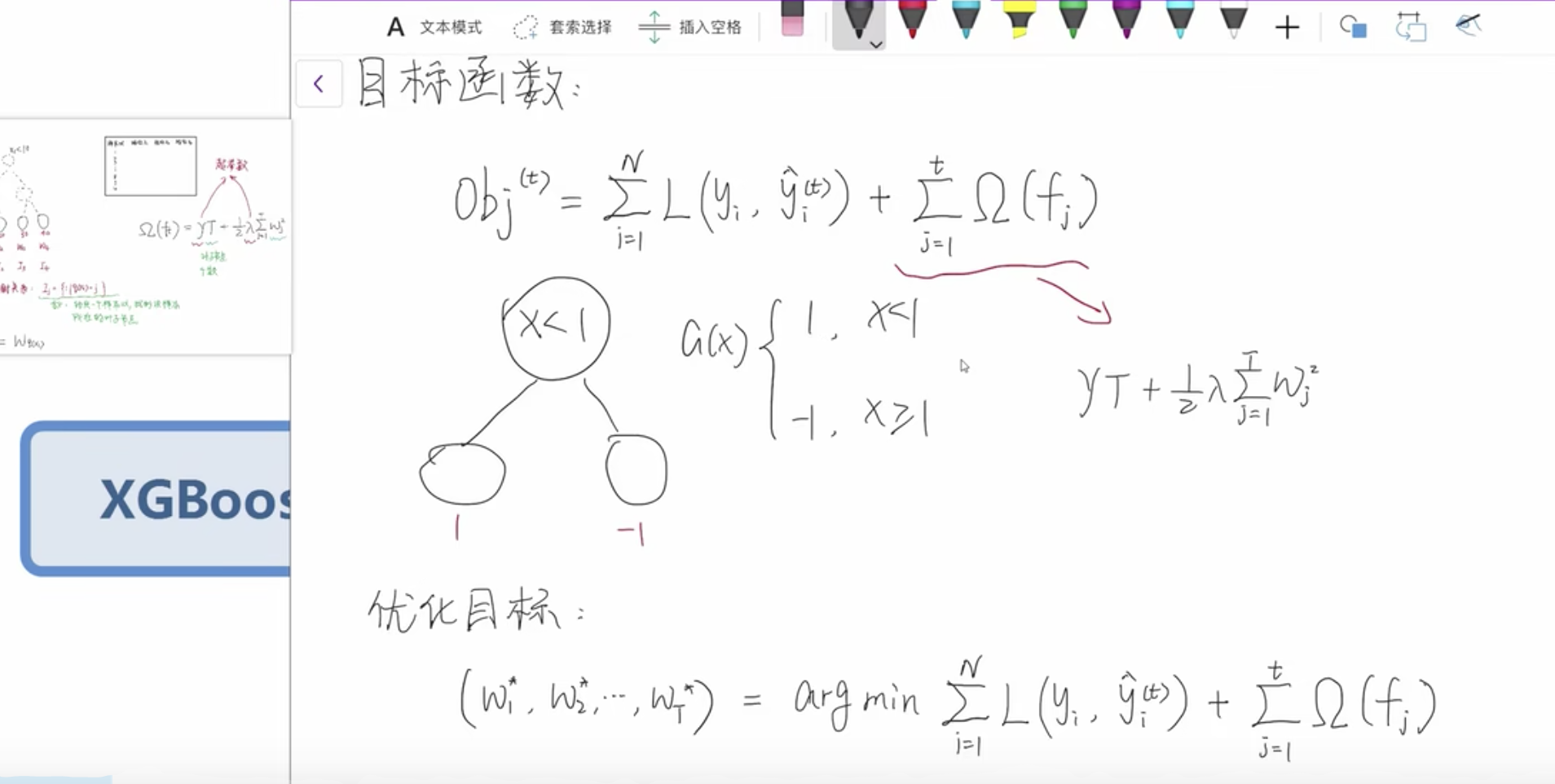

问:为什么不用梯度下降算法而是用前向传导

答:因为阶越函数有关,他是二分类,要么是1要么-1,所以没办法求导问:为什么会有泰勒展开这一步

答:因为损失函数是不确定的,但是我们又想找到共同之处。(GBDT-一阶展开,XGBOOST-二阶展开)

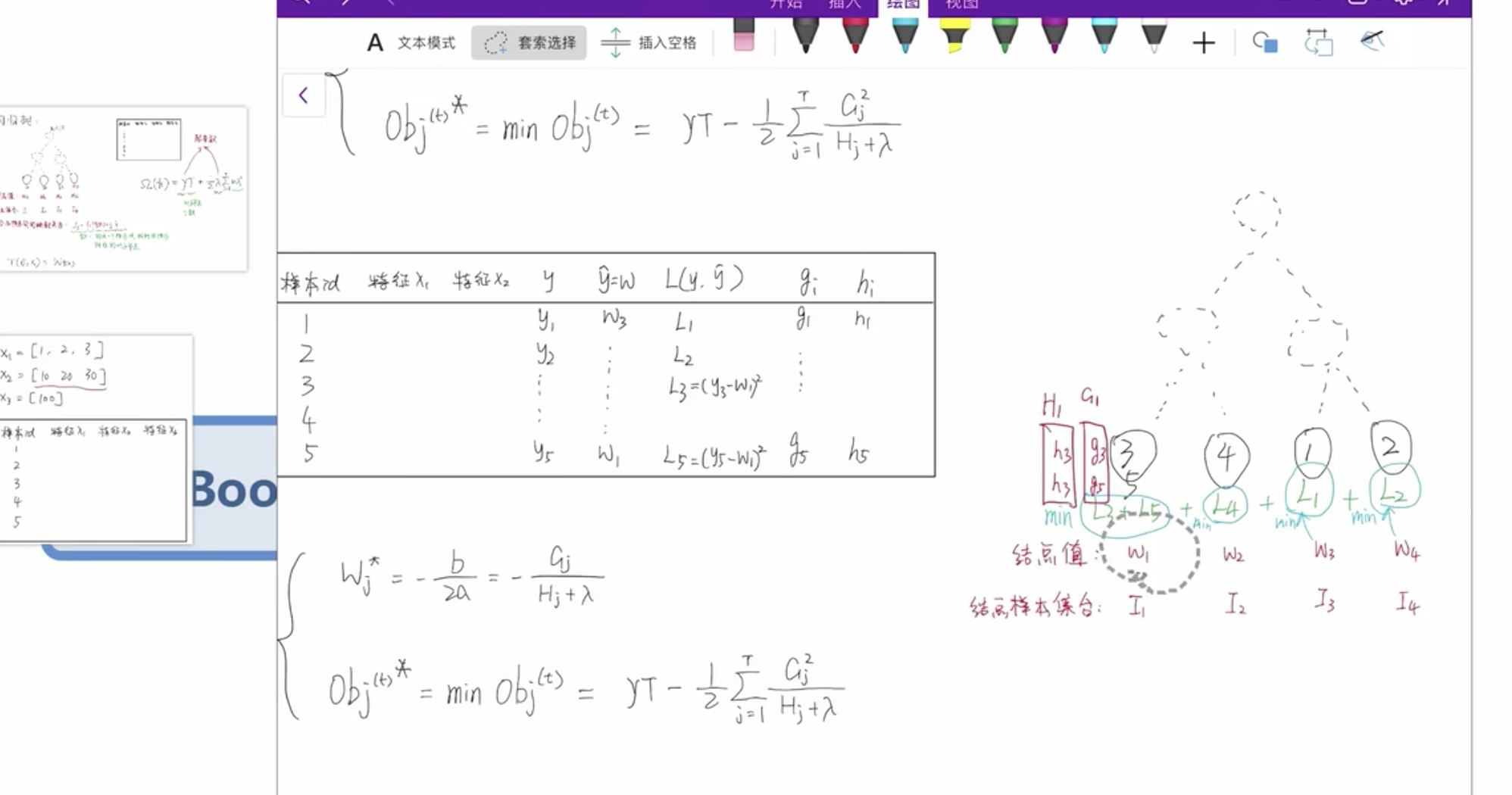

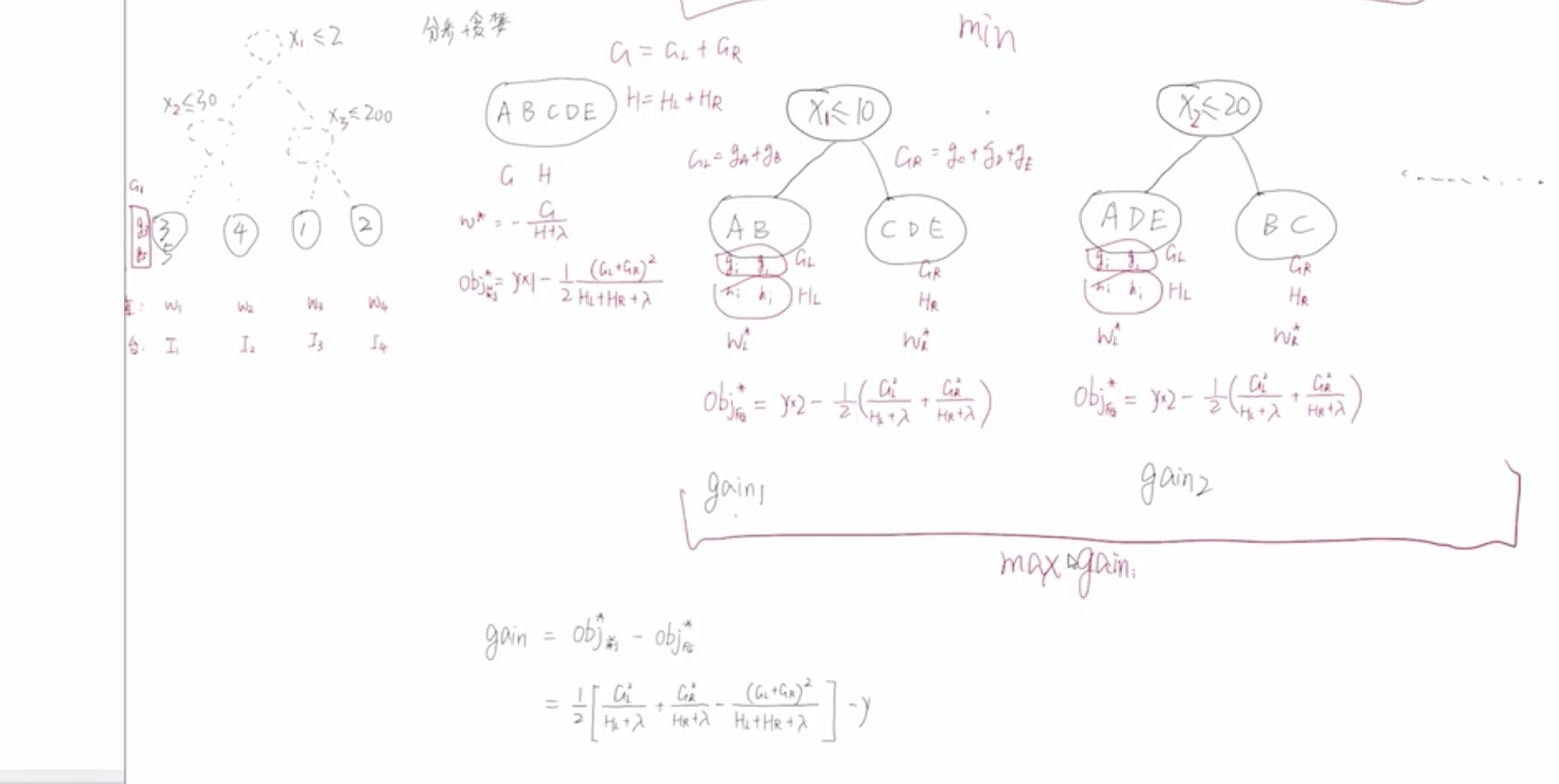

问:怎么分裂结点

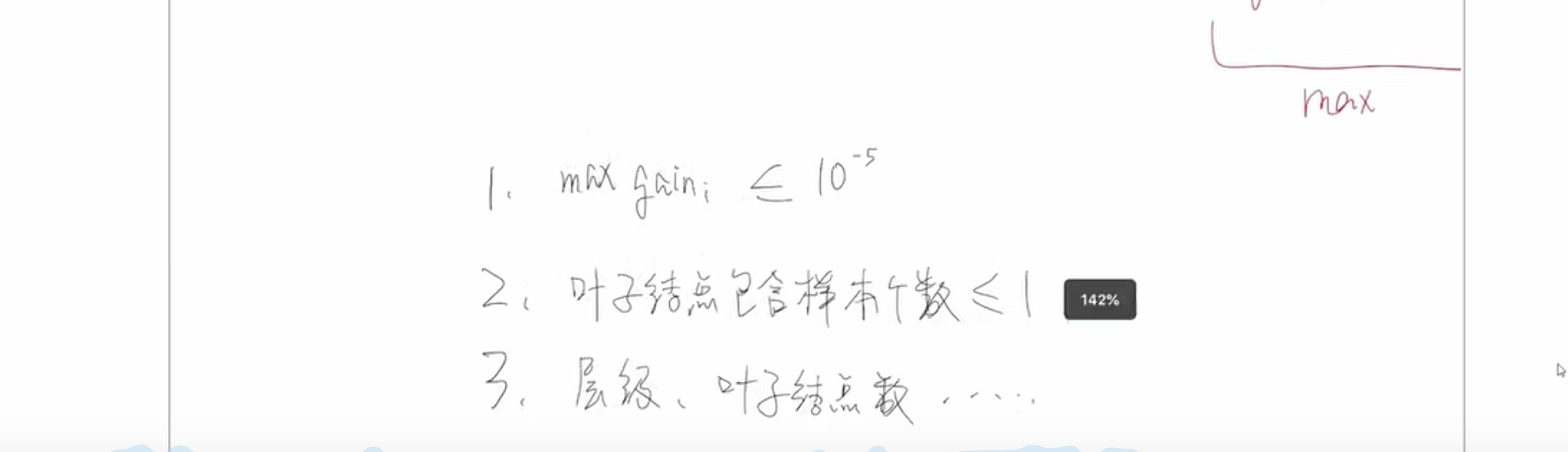

问:怎么样算结束呢

答:

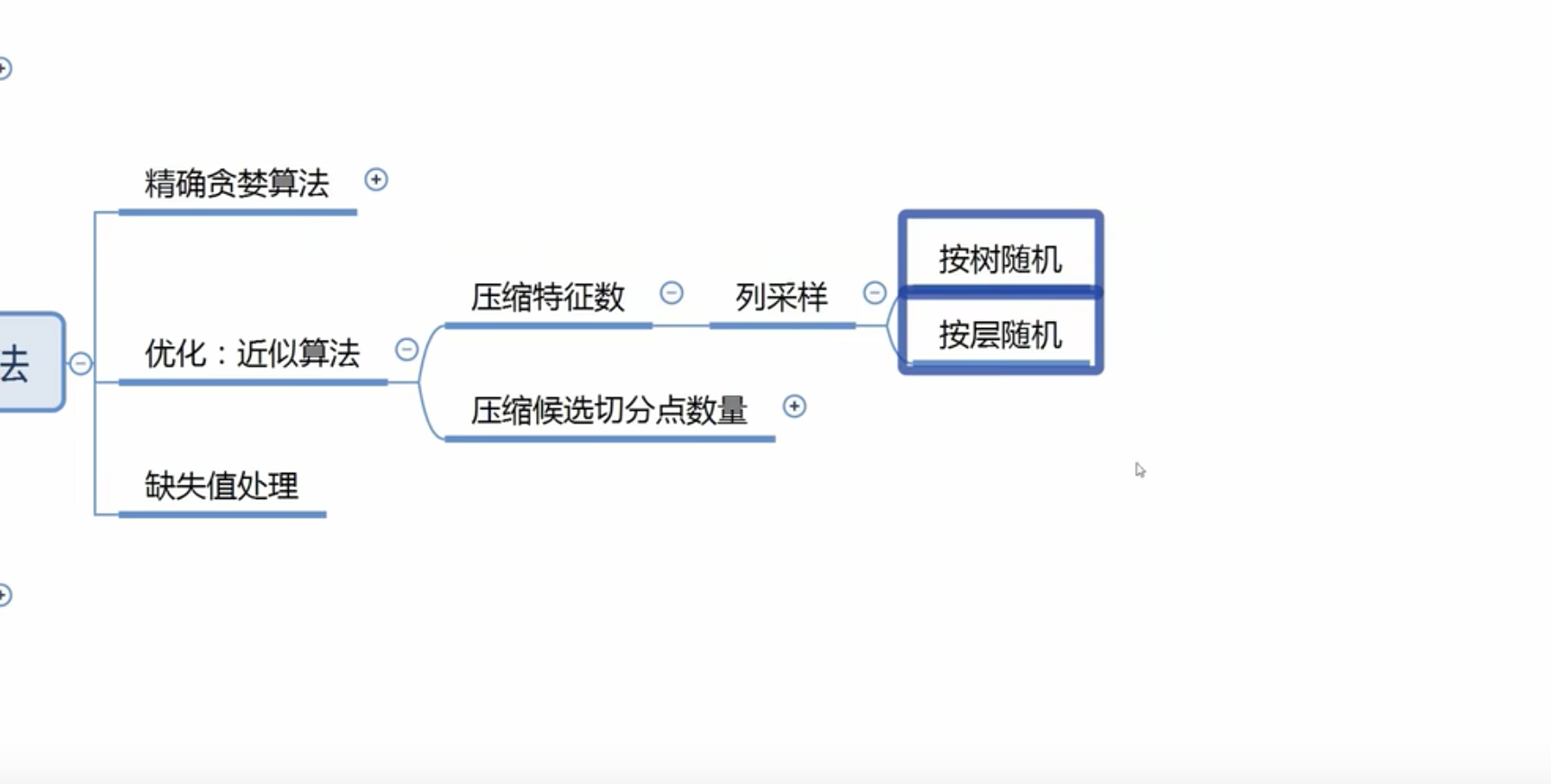

问:有没有什么优化方法?

答:

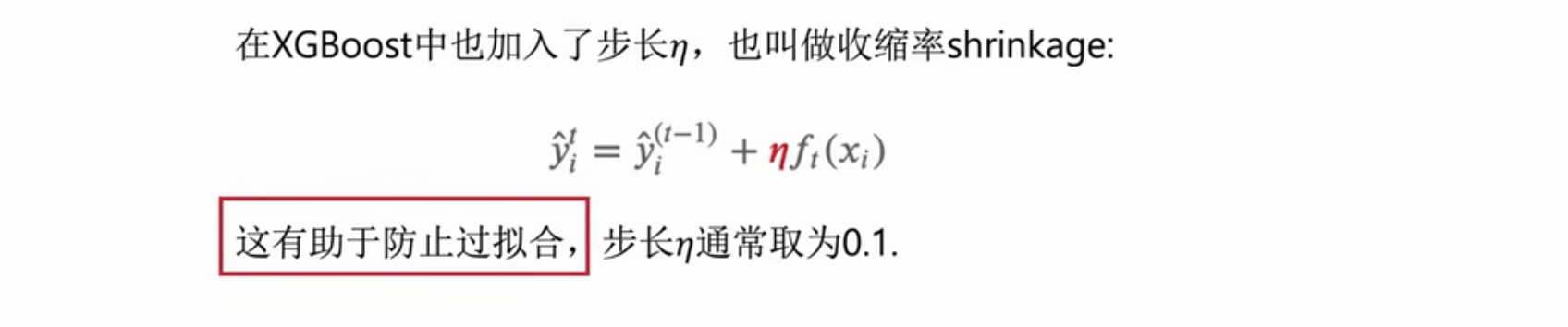

shrinkage 是啥呢?

答:

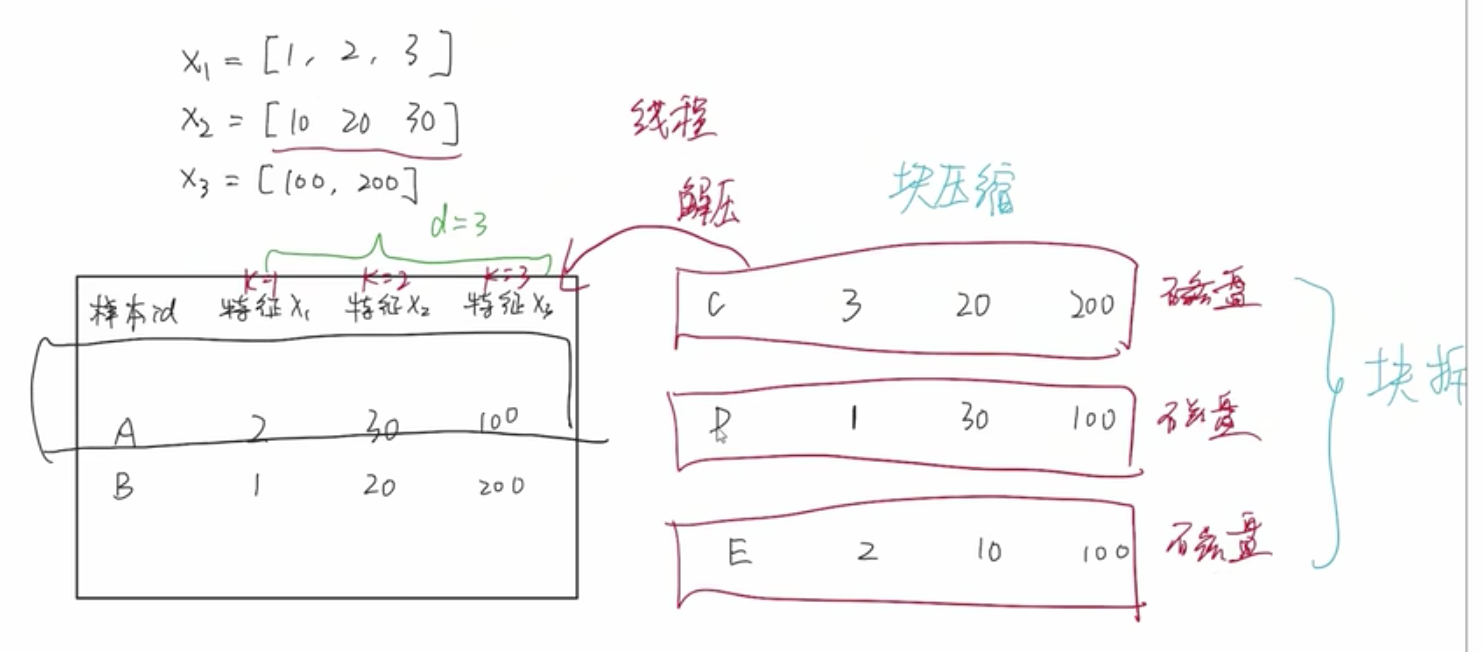

核外块运算

答:

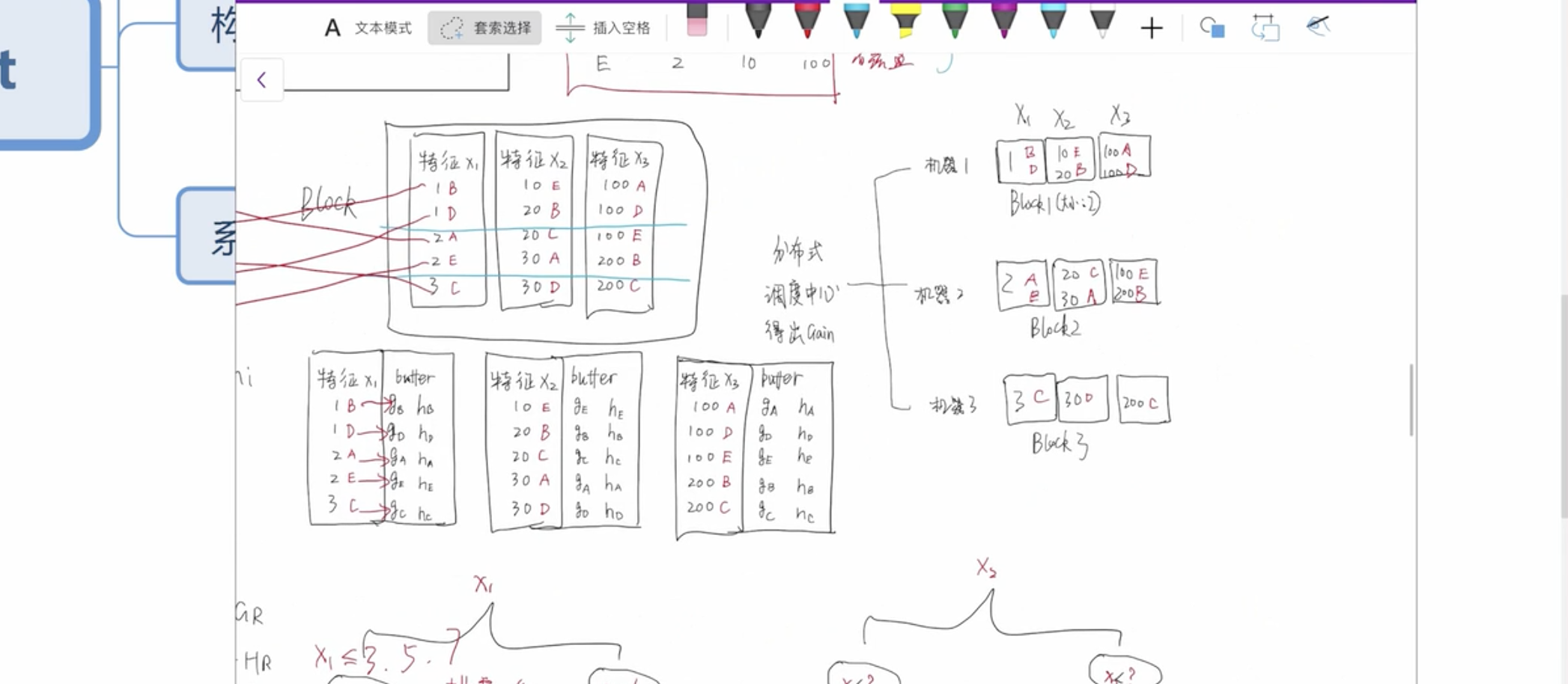

缓存优化

答:

xgboost 学习